La CNIL a prononcé une sanction de 20 millions d'euros à l'encontre de Clearview AI, la société américaine de reconnaissance faciale.

Une amende maximale

La CNIL (Commission Nationale de l’Informatique et des Libertés) avait déjà mis en garde la société américaine sur sa manière de procéder, et les données biométriques que cette dernière récoltait.

Pour rappel : Clearview AI est une entreprise américaine de reconnaissance faciale qui nourrit son modèle d’algorithme en lui faisant parcourir et télécharger des centaines de milliers de photos disponibles sur Internet. Ce processus n’est pas du tout discriminatoire, et les données de plus ou moins tout le monde sont susceptibles d’être utilisées pour entraîner cette Intelligence Artificielle. Et c’est donc ce problème qui est pointé du doigt par la CNIL qui invoque le RGPD (Règlement Général pour la Protection des Données) pour, dans un premier temps, envoyer une mise en demeure à l’entreprise, et les enjoindre à prendre les mesures nécessaires.

Mais cette première mise en garde n’a apparemment même pas provoqué de réponse de la part de Clearview, et c’est pourquoi le couperet tombe désormais avec une amende de plus de 20 millions de dollars, ce montant étant basé sur l’amende maximale possible pour violation du code de la protection des données, porté à 4% du chiffre d’affaires.

L’analyse de la CNIL a relevé plusieurs infractions telles que le traitement illicite de données personnelles, le droit des personnes non respectées ou l’absence de coopération de l’entreprise concernée avec les services de la Commission. Elle renouvelle donc sa demande de cesser de collecter et d’utiliser les données personnelles de milliers de Français, ainsi que celle de supprimer les données déjà collectées sans accord préalable.

Le comportement de Clearview AI a déjà engendré d’autres condamnations auprès d’autres pays tels que l’Australie, le Royaume-Uni, la Grèce ou encore l’Italie, avec lesquels la CNIL a également travaillé et « partagé le résultat des investigations ».

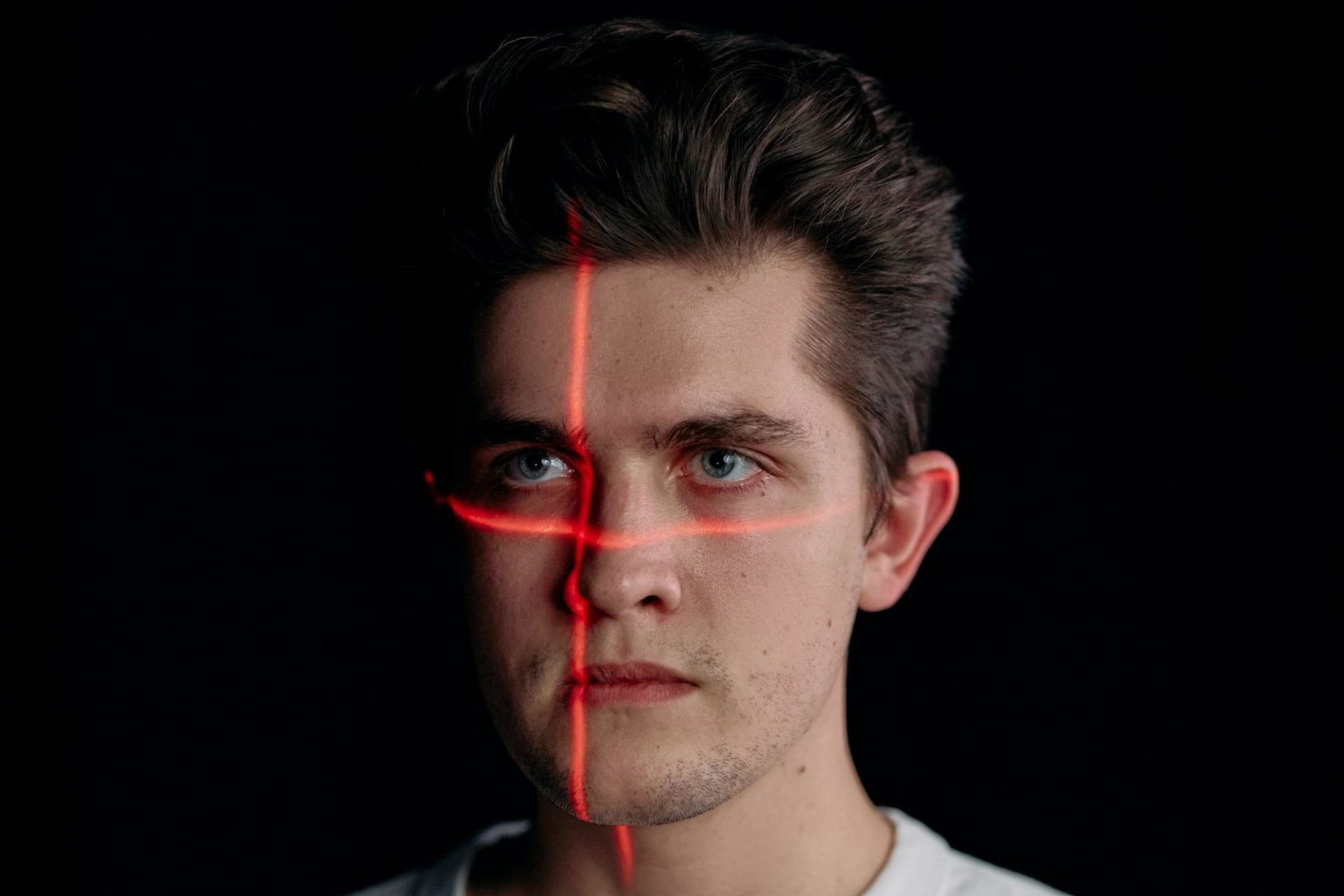

Une méthode de fonctionnement controversée

La façon de procéder de Clearview repose sur l’engloutissement massif de données qui seront ensuite accumulées et traitées au fur et à mesure, sans faire de distinction particulière, et en faisant fi de tout potentiel manquement à la loi. Cette méthode de récolte de données appelée « scrapping » repose sur l’automation de ce processus à l’échelle de tout l’internet public, et ce donc sans se préoccuper de si les différents sites visités aient donné leur accord ou non (et encore moins concernant les individus dont les photos sont utilisées).

Cette collecte concerne donc des personnes majeures, mais aussi mineures, car aucun filtre n’est mis en place pour limiter le type de données « aspirées », et la plupart des types de sites sont donc « scrappés » : sites publics, blogs, réseaux sociaux, extraits vidéos…

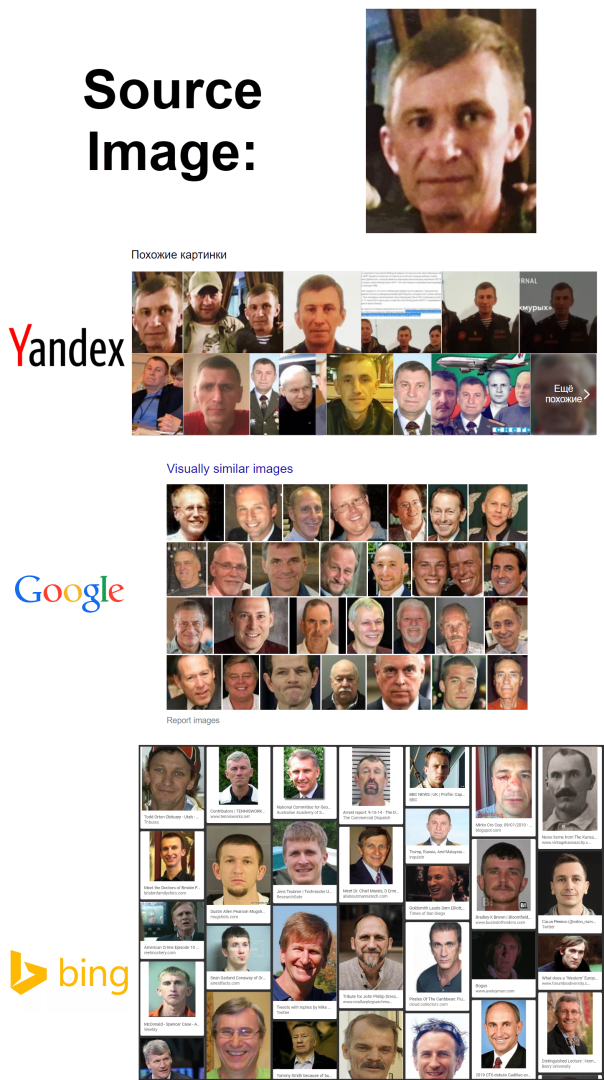

D’autres sites comme « Yandex », le moteur de recherche Russe, est aussi connu pour avoir utilisé cette méthode pour alimenter son algorithme de reconnaissance faciale, et ce d’une façon redoutable, et depuis même plus longtemps que Clearview. Le résultat est aussi impressionnant que troublant : si vous cherchez le visage d’un inconnu sur ce moteur (même sans connaître son nom), vous aurez de fortes chances de retrouver d’autres photos de cette personne avec une précision redoutable, et ainsi potentiellement trouver son nom ou d’autres informations sensibles (adresse, situation familiale, amis…) qui pourraient être utilisées à mauvais escient, ou à des fins publicitaires.

Un comparatif permettant de montrer la différence flagrante de précision entre les différents moteurs de recherche

Une perspective que redoute la majeure partie des organisme responsable de la privatisation de données, et qui cherchent donc à limiter la construction de projet tels que ceux de Yandex ou Clearview, afin de préserver le droit à la protection des données, et encore plus lorsqu’il s’agit de données aussi sensibles que le visage d’un individu.

Pour aller plus loin :

→ Les recherches internet étonnantes des Russes